Base de données vectorielle pour l'IA portable

Des performances qui font leurs preuves en production

QPS à 10 millions de vecteurs

Conçu pour les applications d'IA en temps réel qui ne peuvent se permettre aucune attente.

rappel à grande échelle

La précision reste inchangée, même si votre jeu de données .

millisecondes

une latence de 99 ms pour garantir des performances constantes, du prototype à la production.

déploiement sécurisé de l'IA déploiement

Découvrez comment Actian VectorAI DB vous aide à créer et à exploiter des applications d'IA partout, sans dépendre du cloud. Cette base de données vectorielle portable, conçue pour une utilisation locale, offre des performances de recherche rapides et prévisibles tout en vous permettant de garder le contrôle total de vos données et de votre infrastructure.

La base de données vectorielle dans le cloud n'a pas été conçue pour votre cas particulier

La latence du réseau entrave le fonctionnement des applications en temps réel

Les allers-retours vers le cloud ajoutent 200 à 400 ms à chaque requête effectuez. Il est impossible de développer des applications dont le temps de réponse est inférieur à 100 ms lorsque votre base de données est la principale source de latence.

Les infrastructures tierces entravent les déploiements réglementés

La loi HIPAA et le RGPD exigent que vous gardiez le contrôle de vos données. Les services cloud impliquent un traitement par des tiers qui ne respecte pas vos exigences en matière de conformité.

Une architecture exclusivement basée sur le cloud empêche la mise en œuvre de certains déploiement

Vos appareils en périphérie, vos environnements hors réseau et Embarqué ne peuvent pas compter sur une connexion Internet fiable. Les bases de données dans le cloud ne permettent pas de prendre en charge certaines catégories de vos applications d'IA.

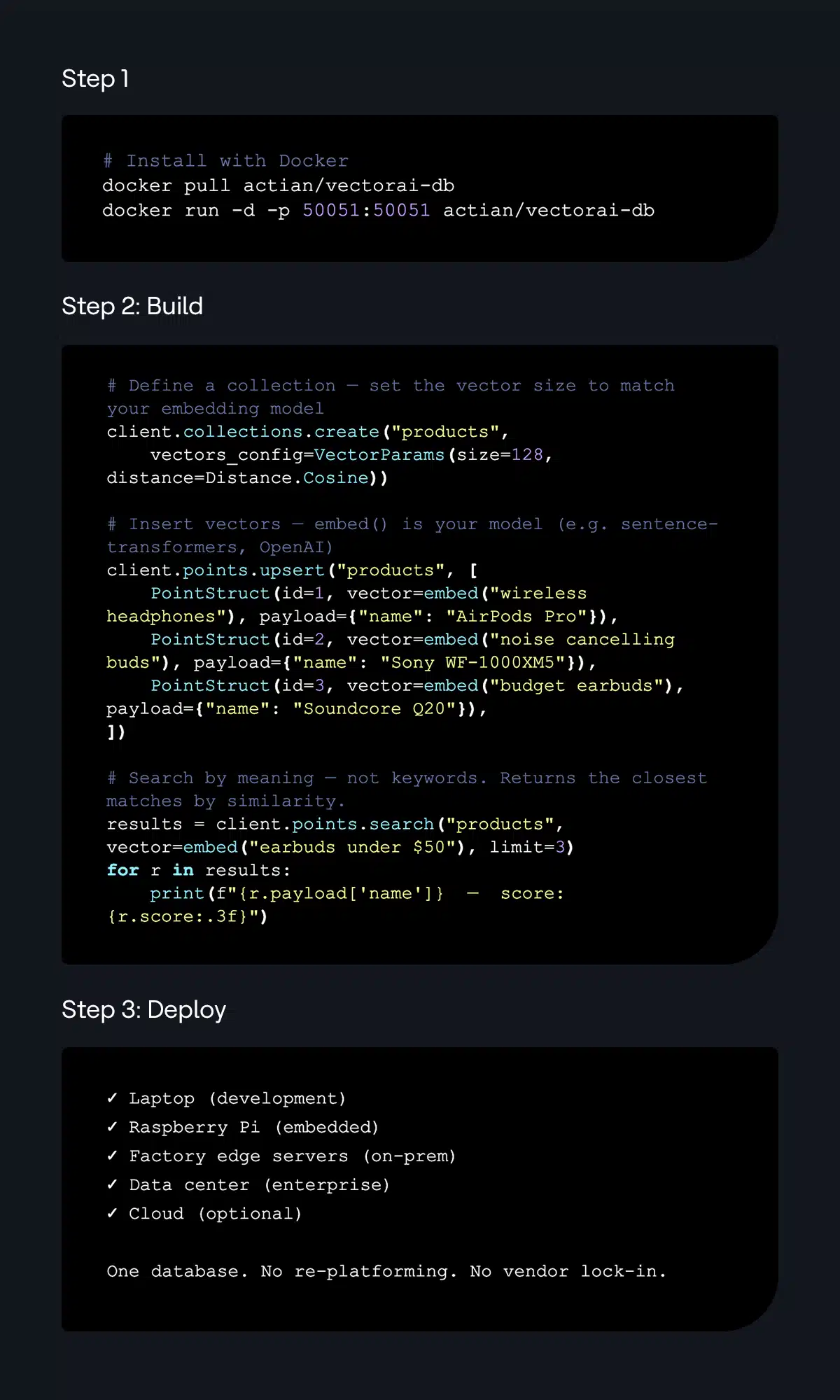

De l'installation à la mise en production en quelques minutes

Découvrez des ressources et développez des applications dans le langage de votre choix.

Une tarification qui s'adapte à la manière dont vous développez votre IA

Commencez gratuitement, testez vos solutions en local, puis passez du prototype à la production sans modifier votre architecture. VectorAI DB propose des formules flexibles destinées aux développeurs qui créent des pipelines RAG, des agents et des applications d'IA en périphérie, que ce soit en local, sur site ou dans le cloud.

Conçu pour les développeurs en périphérie

Actian VectorAI DB permet une IA portable grâce aux capacités suivantes :

FAQ

Actian VectorAI DB est une base de données vectorielle portable, privilégiant le traitement local, conçue pour les systèmes d'IA qui fonctionnent en dehors du cloud. Elle permet aux développeurs d'effectuer des recherches sémantiques et hybrides à proximité de leurs données, offrant ainsi faible latence et une récupération prévisible dans les environnements en périphérie, sur site, hybrides et dans le cloud.

La plupart des bases de données vectorielles sont conçues pour des déploiements natifs du cloud, tandis que VectorAI DB est conçue pour fonctionner de manière homogène dans des environnements en périphérie, sur site, hybrides et dans le cloud. Elle offre une récupération portable privilégiant le local, avec des performances prévisibles, notamment un débit de requêtes par seconde (QPS) jusqu’à 22 fois supérieur à grande échelle sur un matériel auto-hébergé identique.

VectorAI DB prend en charge les méthodes modernes d'indexation par « voisin le plus proche approximatif » (ANN), notamment HNSW, pour permettre des recherches à grande échelle, faible latence et de haute précision.

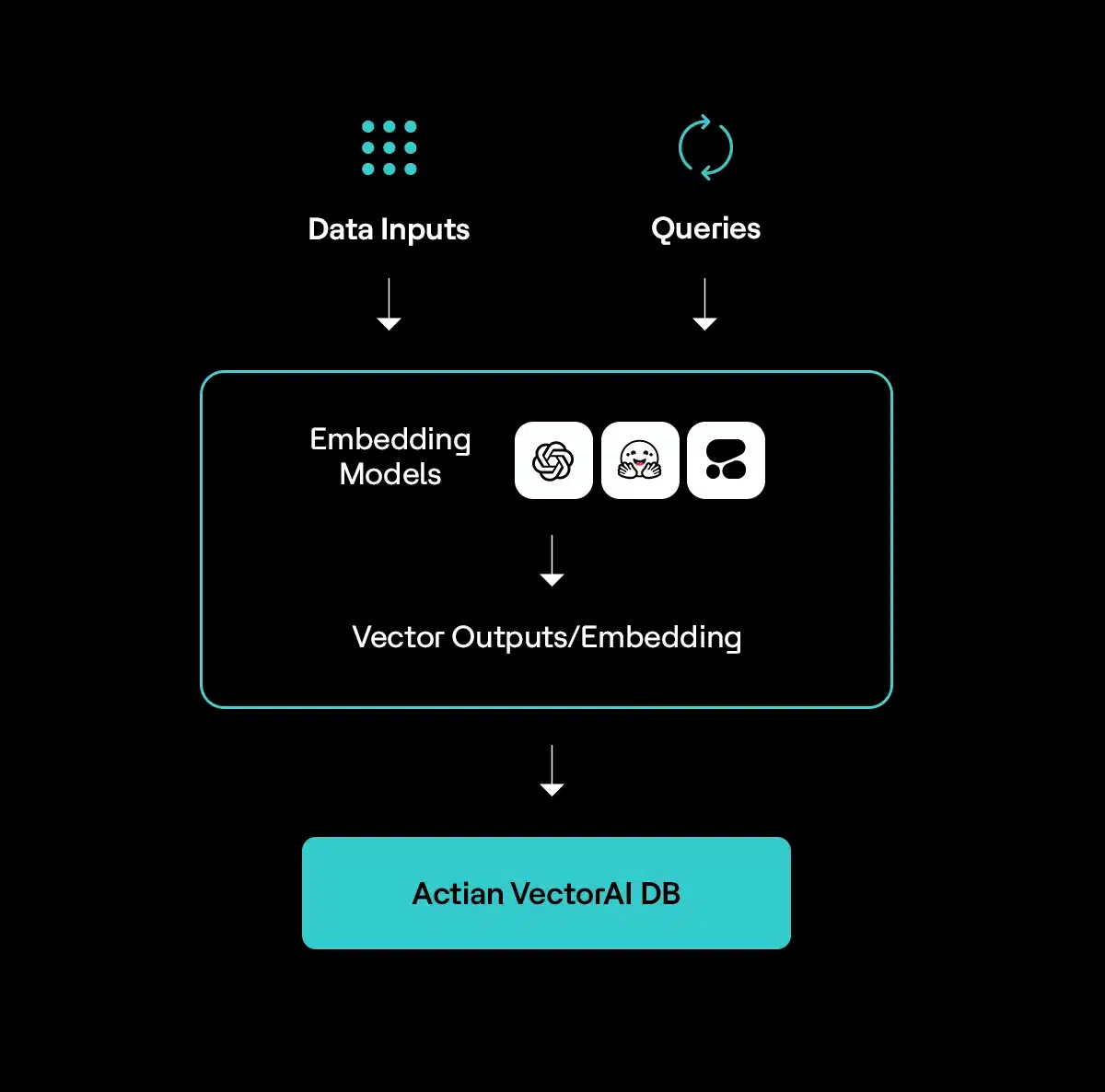

VectorAI DB est indépendant du modèle et fonctionne avec des représentations générées par n'importe quel fournisseur ou framework. Cela inclut OpenAI, Anthropic, Cohere, les modèles open source tels que Hugging Face, ainsi que les modèles personnalisés ou optimisés.

Oui. VectorAI DB permet de créer et de stocker des représentations vectorielles à partir de sources de données multimodales telles que du texte, des images, des fichiers audio et des vidéos.

Vous ne savez pas par où commencer ?

Discutez avec notre équipe de la manière dont les entreprises utilisent VectorAI DB pour créer des agents IA, réduire les délais de récupération, conserver les données sensibles en local et déployer l'IA dans des environnements où les bases de données cloud ne fonctionnent pas. Nous pouvons vous aider à évaluer les architectures, déploiement et les cas d'utilisation concrets de l'IA.

Réservez une démonstration personnalisée

(par exemple : sales@..., support)